AAAI 2022|AI顶会论文究竟关注什么?

2022-01-27 | 作者:微软亚洲研究院

编者按:AAAI 是由人工智能促进协会(Association for the Advancement of Artificial Intelligence)主办的人工智能领域顶级学术会议之一。今年的AAAI 大会将于2月22日-3月1日举办,微软亚洲研究院共有十余篇论文入选,涵盖概念漂移、平面布局自动生成、假新闻检测、视频分割、跨语言预训练、文本摘要、注意力机制、连续深度神经网络、领域泛化、在线影响力最大化等等人工智能的多个领域。今天,我们为大家精选了其中的12篇进行分享,并配有此前的论文分享直播视频,希望可以帮助大家更深入地了解人工智能领域的前沿进展!

基于数据分布生成的可预测概念漂移适应

论文链接:https://arxiv.org/abs/2201.04038

代码链接:https://github.com/microsoft/qlib/tree/main/examples/benchmarks_dynamic/DDG-DA

在时序数据中,由于环境的不稳定性,数据分布常常会随时间变化,且这种变化通常被认为是难以预测的。这种现象被称为概念漂移(Concept Drift),它会导致在历史数据上训练的模型在概念漂移后性能下降。为了应对这一问题,此前的工作会检测概念漂移是否发生,然后调整模型以适应最近的数据分布。但是在很多实际场景中,环境的变化是有规律可预测的,即可预测的概念漂移(Predictable Concept Drift)。因此,可以对概念漂移的未来趋势进行建模,而不仅仅让模型适应最近的数据分布。

微软亚洲研究院的研究员们提出了一种新方法 DDG-DA 来预测数据分布未来的变化,然后利用预测的数据分布生成新的训练数据来学习模型以适应概念漂移,最终提升模型性能。

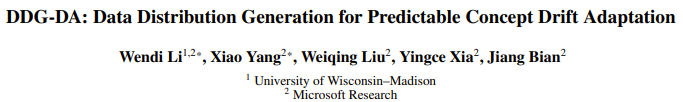

图1:DDG-DA 学习如何生成数据来最小化历史数据分布和未来数据分布的差异

具体来说,如图1所示,在时序数据中样本随时间产生,算法可以利用当前时刻已经产生的历史样本学习或调整模型用于未来一段时间的预测。由于历史数据的分布和未来数据分布存在差异,这会影响所学模型的预测性能,DDG-DA 则致力于缩小这种分布差距。DDG-DA 会输出历史数据的采样权重,基于该权重重新采样生成数据集,该数据集的分布会作为未来一段时间分布的预测。同时,研究员们还设计了一个和 KL-divergence 等价的分布距离函数来计算预测的分布和未来一段时间实际分布的距离。该距离函数具有可导的性质,因此可以利用它高效地学习 DDG-DA 的参数来最小化它预测的分布误差。在学习阶段,DDG-DA 先在历史时序数据上学习如何重采样数据;在预测阶段,DDG-DA 会定期通过重采样历史数据生成训练数据集,在 DDG-DA 生成的数据集上训练的模型将能更好地适应未来变化的数据分布/概念漂移。

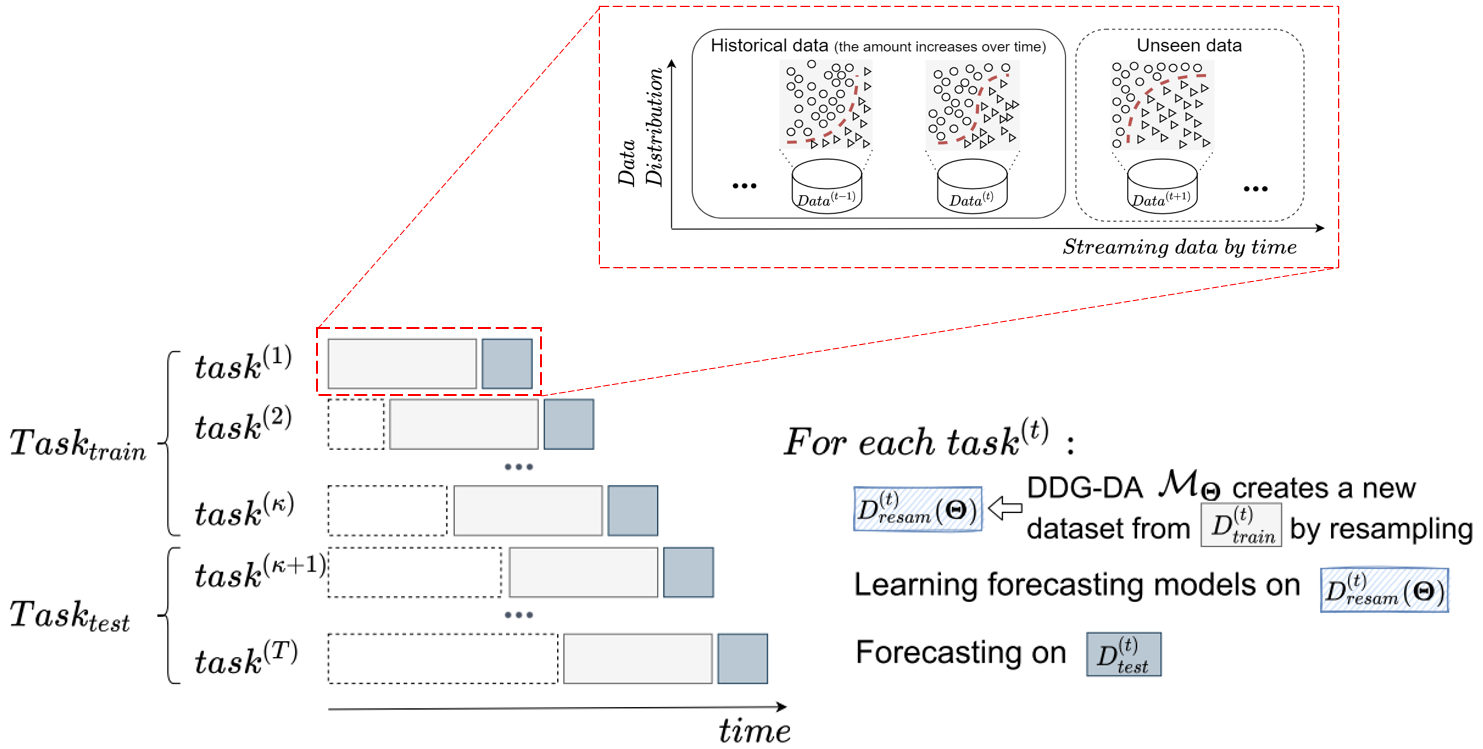

如表1,研究员们在股价、电力负荷和日照辐照度三个真实场景预测任务和多个模型上进行了实验验证并且性能得到了显著提升,在同类方法中 DDG-DA 也取得了最佳性能。

表1:DDG-DA 和同类方法在不同场景下的对比

平面布局的层次化生成式建模

论文链接:https://www.microsoft.com/en-us/research/publication/coarse-to-fine-generative-modeling-for-graphic-layouts/

平面布局(graphic layout)在工作和生活中随处可见,如海报的布局、文档的布局、移动应用用户界面的布局等。设计一个美观的平面布局不仅需要过硬的专业知识而且需要花费大量的精力。为了辅助平面布局的设计,平面布局的自动生成(layout generation),即预测布局中各个元素的位置和大小,逐渐受到越来越多的关注。

现有的大多数模型会将平面布局抽象成一系列的元素,并直接预测每个元素的位置和大小。本文提出将平面布局切割为不同的“区域”(region),其中每个区域都可以看作是一个简单的布局且比整体布局包含更少的元素,并基于此设计了一种层次化的模型。

具体来说,研究员们将 VAE 中的解码器分解为两个步骤:第一个步骤为预测区域。由于平面布局中没有显式的包含区域的划分,本文设计了一种基于网格线的方法来抽取此步骤中的监督信息。第二个步骤为基于生成的区域,预测区域中每个元素的具体位置和大小。为了使模型能够将区域中元素的预测问题当作一个简单的布局生成问题,此步骤中的所有位置被转成了对于区域的相对位置。

图2:模型架构

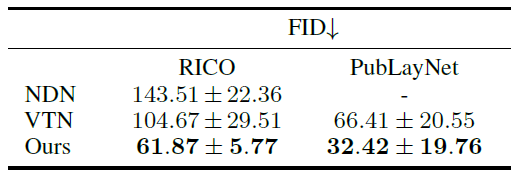

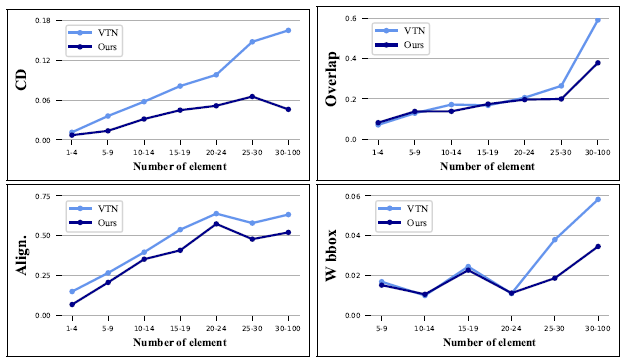

大量的定性和定量实验证明,本文提出的方法优于现有方法,其优势在复杂布局生成上尤为突出。表2比较了不同模型的 FID 值,图3则比较了在不同复杂度的布局上各个模型的效果。更多定量和定性结果请参考论文。

表2:模型 FID 值比较

图3:不同复杂度的布局上模型效果比较

基于推理的假新闻检测

论文链接:https://arxiv.org/abs/2110.15064

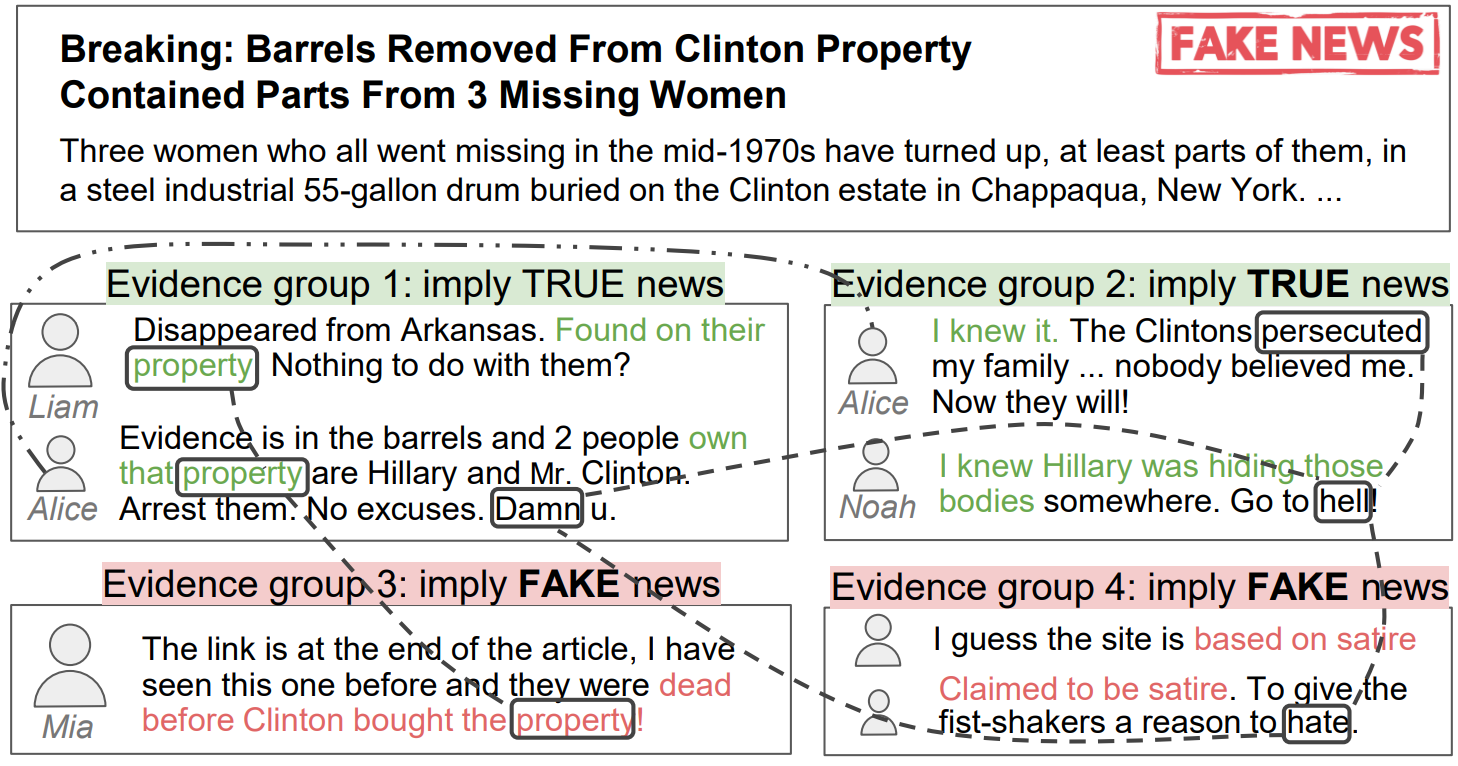

目前假新闻检测方法以数据驱动的方式进行预测,充分证明了利用大数据进行假新闻检测的有效性。然而,现在仍缺少从推理的角度来做假新闻检测的研究。在心理学中,推理能力是指有意识地运用逻辑探索真理的能力,通常被认为是一种人类独有的能力。这种推理能力对提高假新闻检测的可解释性和准确性至关重要。比如,如果能让模型学会像人一样有逻辑地把微小的线索组织起来(图4),就能给假新闻检测方法带来强大的细粒度推理能力,从而提升准确性。

图4:判断新闻真假常常需要精细推理的能力。虽然图中四组证据看上去众说纷纭,但人类可以通过诸如 "property" 等微妙线索将它们在逻辑上联系起来,从而对文章得出更可信的结论。

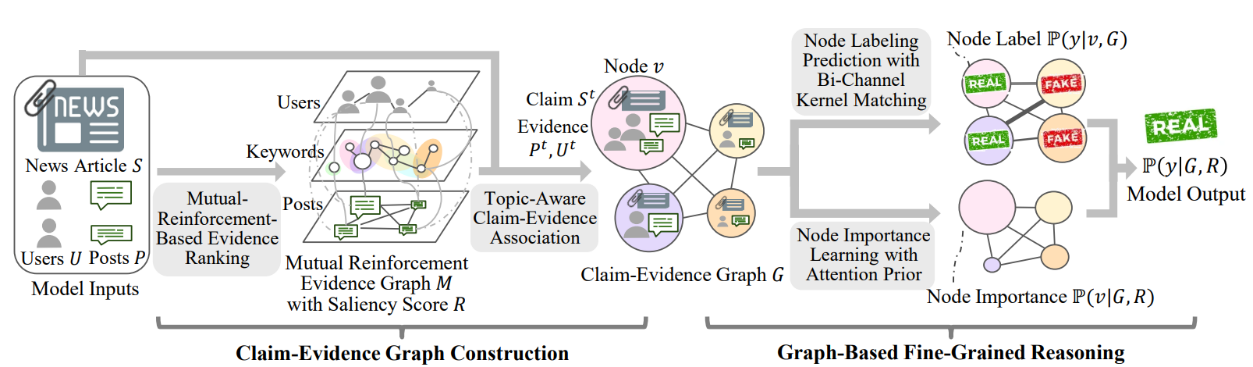

图5:推理框架 FinerFact

在本文中,微软亚洲研究院的研究员们提出了一个通用的推理框架 FinerFact,用于对假新闻检测进行细粒度推理(图5)。FinerFact 遵循人类的信息处理模式,能够更好地反映人类的逻辑推理过程,增强了可解释性。同时,FinerFact 引入了一种基于 Mutual-Reinforcement 的方法来将线索进行排序,这使研究员们能够更好地了解哪些类型的证据对识别假新闻更重要,并为融入人类的知识经验提供基础。最后,FinerFact 引入了一个双通道的 Kernel Graph Network 建模不同类型线索之间的细微差异与影响。

表3:FinerFact 在 PolitiFact 和 GossipCop 数据集上的表现

大量实验表明,FinerFact 优于目前最先进的方法并能提供较强的可解释性(如表3所示)。除了提高准确性之外,FinerFact 还使人类能够理解其推理过程中的大部分内容。在 Case Study 中,FinerFact 不仅成功地识别新闻为假,而且对重要的证据、细微线索以及每个观点的预测分数都进行了详细解释(图6)。

图6:可视化 FinerFact 的推理过程:(a)Mutual Reinforcement Graph 中的 keyword 层,每个 keyword 的显著性表示为 keyword 的大小;(b) 在 Claim-Evidence Graph 进行细粒度推理。每种颜色表示新闻证据中的一个主题。

用于在线视频实例分割的混合实例感知的时序融合方法

论文链接:https://arxiv.org/abs/2112.01695

相较于图像分割,有效利用时序一致性是视频分割的核心问题。本文提出了一种基于实例感知的时序融合方法,用于在线视频实例分割(Video instance segmentation)框架。首先,研究员们利用图像分割的一种表示,基于实例的全局编码(instance code)和 CNN 特征图来分别表示实例级和像素级特征。基于这种表示,研究员们引入了一种无需裁剪对齐(ROI align)的时序融合方法来对视频帧之间(Inter-frame)的内容时间一致性进行建模。具体地,研究员们在实例编码中对全局实例信息进行编码,并通过实例编码和 CNN 特征图之间的混合注意力机制建模帧间的上下文融合。利用学习到的混合时间一致性,研究员们能够直接检索和维护跨帧的实例身份,摒除了先前方法中复杂的逐帧实例匹配方案,提高方法效率。如图7所展示的帧间注意力图,对于不同的参考帧,当前帧的关注点在像素级和实例级都在时序上是一致的(不同颜色表示不同实例)。

图7:帧间注意力图可视化

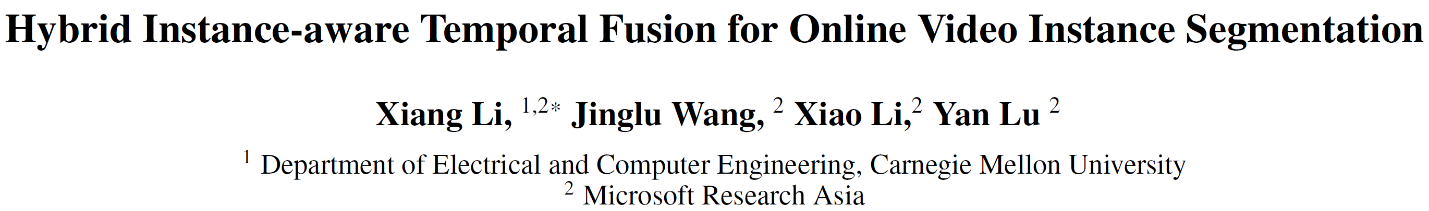

图8描述了该方法的具体框架。研究员们通过引入混合的帧间通讯来强制视频实例分割中的时间一致性,突出显示了两个主要组件,即用于连接当前实例编码和功能的帧内注意力和帧间注意力,以及用于融合相邻帧中的混合(像素级和实例级)时序信息。首先,N 个帧内注意力层被集成到卷积主干中,然后是 M 个注意力层交织帧间和帧内注意力建模。归因于网络结构设计和附加的对比损失函数,最终在不同帧间实例编码顺序能够保持一致(Order consistent)。

图8:框架概述

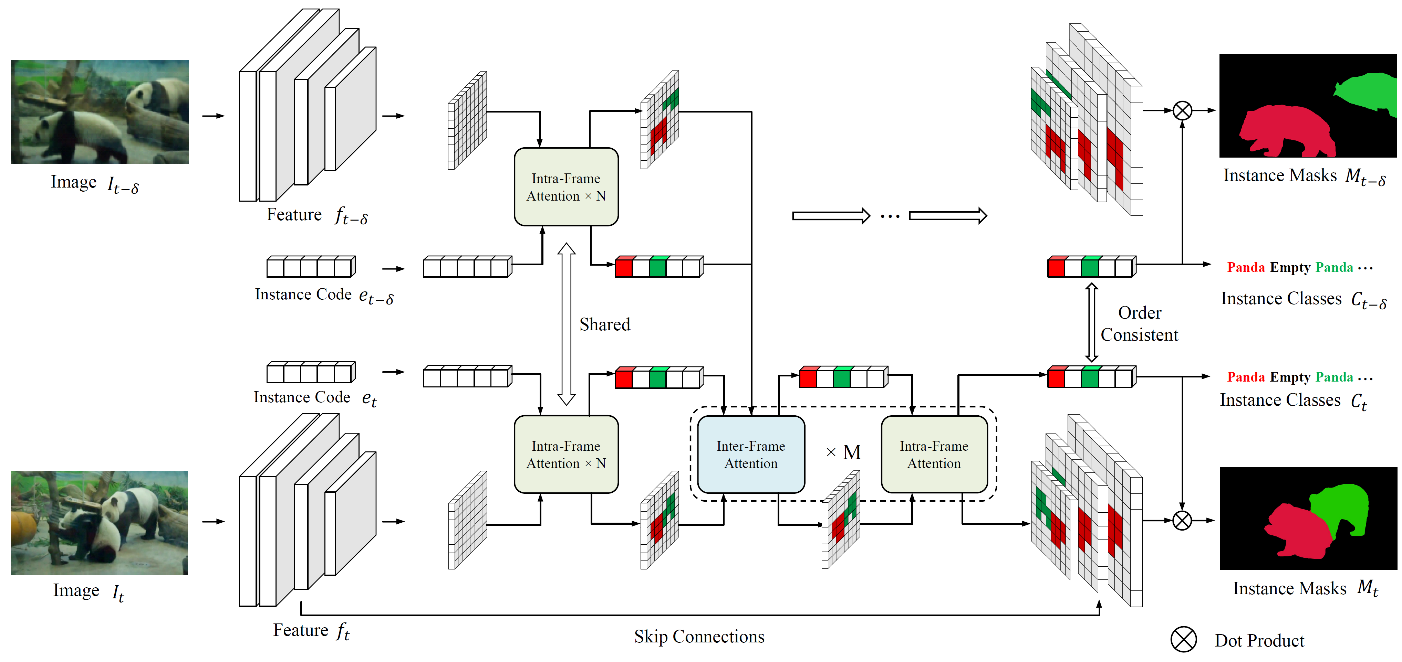

综合实验表明,该模型在 Youtube-VIS-19/21数据集上,与所有在线视频实例分割方法对比,取得了最佳性能,结果在表4展示。

表4:在 YoutubeVIS-2019的视频实例分割结果

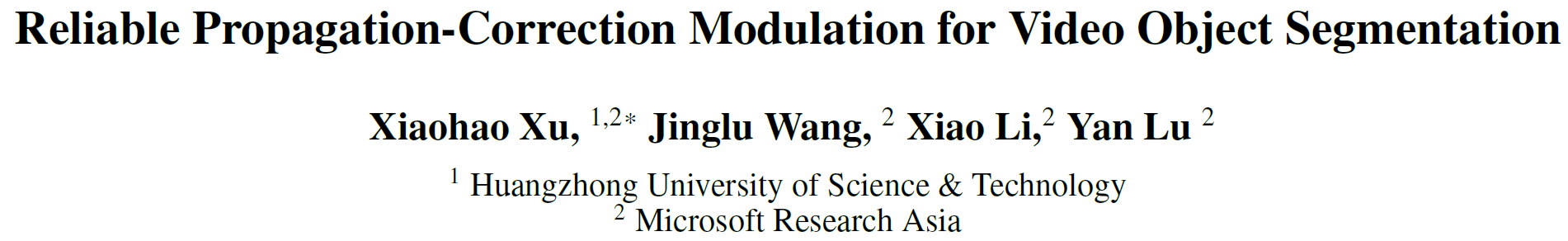

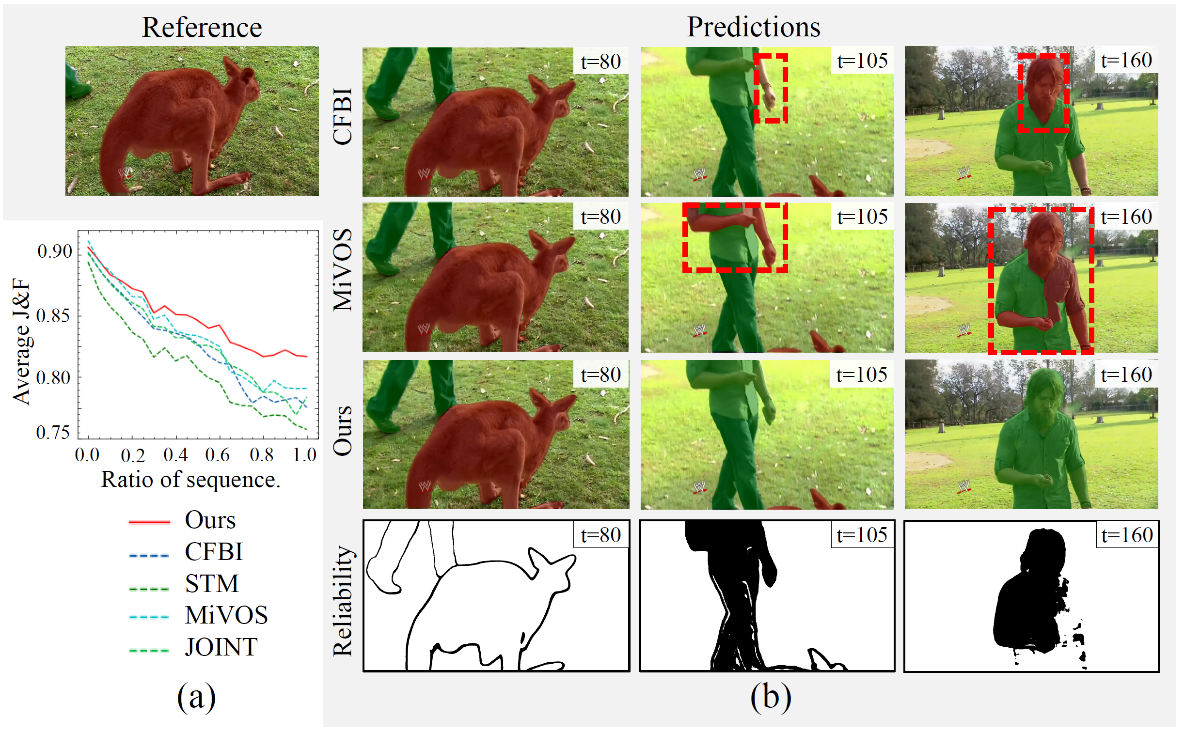

用于视频对象分割的可靠传播-校正调制网络

论文链接:https://arxiv.org/abs/2112.02853

误差传播是视频对象分割(Video object segmentation)中一个普遍但至关重要的问题。如何通过具有高可靠性的校正机制来抑制误差传播,从而提高分割的准确性,也成为研究员们关注的一个重要问题。本文中所提出的方法的核心是把信息流在常规的传播(Propagation)过程和用可靠线索校正(Correction)的过程中解耦。图9概述了该网络框架。微软亚洲研究院的研究员们引入了两种调制器(Modulation)网络,传播和校正调制模块,分别根据局部时间相关性和参考可靠性对目标帧特征逐通道重新校准。具体来说,研究员们使用级联传播校正方案组装调制模块,从而避免了传播模块对校正模块的影响。尽管参考帧提供了可靠的线索,但它可能与目标帧差异较大(如图10,参考帧中的袋鼠在最后一帧消失了,人物外观变化也非常大),具有不完整和不确定的相关性(即被参考的可靠性 Reliability 减弱)。研究员们还通过将可靠的功能补丁补充到维护池(Reliable patch pool),从而为调制网络提供更全面和更具表现力的对象代理表示(Object proxy)。其中可靠性过滤器(Reliability filter)可过滤掉后续帧的不确定补丁。

图9:网路框架概述

图10:该方法的关键是利用可靠线索补全物体对象的表示并抑制误差传播

该模型在当时的 YouTube-VOS18/19 和 DAVIS17-Val/Test 基准测试中达到了最先进的性能,结果在表5展示。图10(a)也展示了该方法随着时间增长准确性下降最少,这归功于模型抑制了误差的传播。

表5:在 Youtube-VOS 2018和2019上的结果

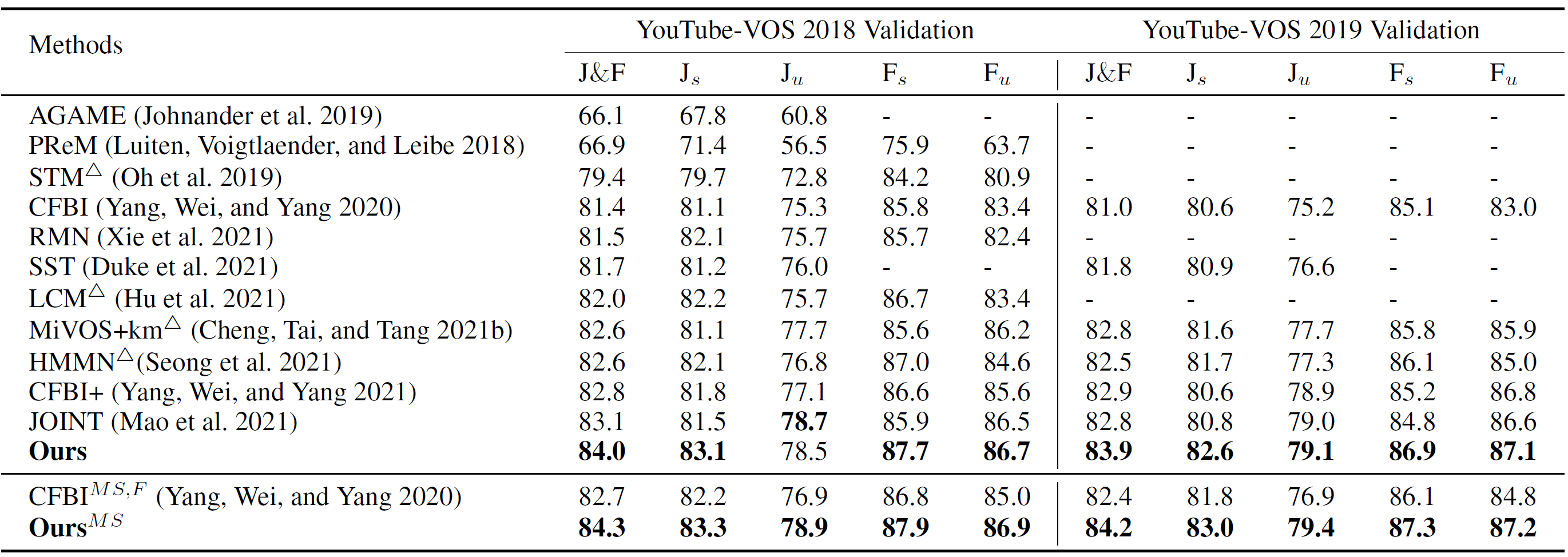

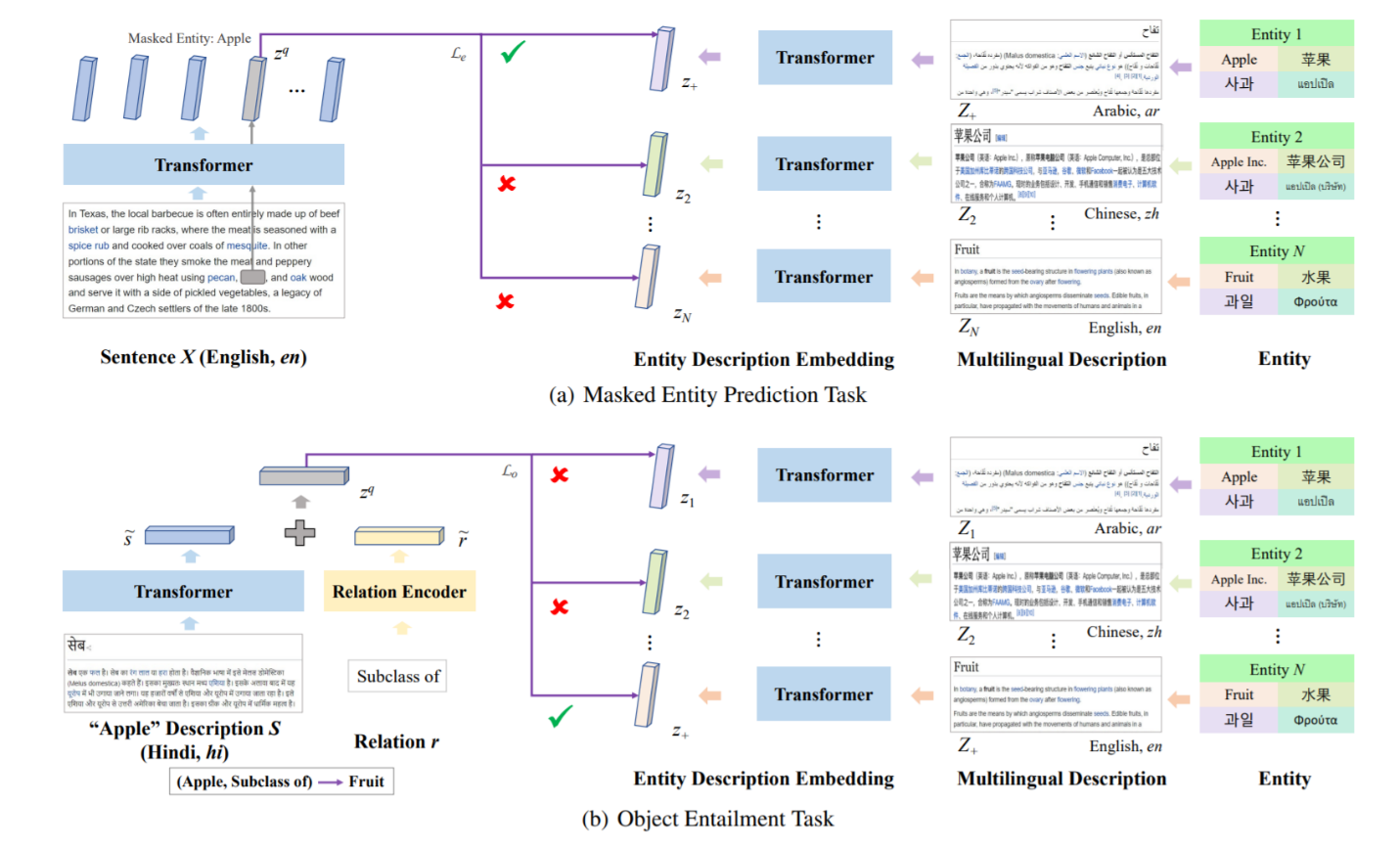

XLM-K:通过多语言知识库提高跨语言预训练模型

论文链接:https://arxiv.org/abs/2109.12573

跨语言预训练的目标是提高模型在语言之间的迁移能力,使模型可以在一种语言上训练,然后在其他语言上直接测试。之前跨语言模型的能力主要来源于单语和双语的普通文本。本文首次提出从多语言的知识库中来学习跨语言能力。多语言知识库中的实体可以同时对应多个语言,提供新的跨语言监督,而且也可以增强模型对于知识的理解。图11为一个多语言知识库的例子。

图11:多语言知识库示例

微软亚洲研究院的研究员们提出了两个新的预训练任务:掩码实体预测(Masked Entity Prediction)和客体推理(Object Entailment)。这两个任务可以帮助模型实现更好的跨语言对齐,以及让模型有更好的记忆知识。掩码实体预测中,在文本输入中有掩码的位置,模型不仅需要预测被去掉的词,还需要预测这个词能够链接到知识库中的哪个实体。例如一段文本中的苹果被去掉后,模型需要判断这个词应该链接到属于水果的苹果还是属于公司的苹果。客体推理任务中,模型的输入是一段描述主体(subject)的文本以及主体和客体(object)的关系,模型需要预测的客体是什么。例如,主体是“苹果“的介绍,关系是“属于子类”,那么客体就是“水果”,因为“苹果属于水果的子类”。两个任务中,输入和输出的问题都可以是不同的语言,因此模型可以获得更好的跨语言性能。

图12:预训练任务介绍

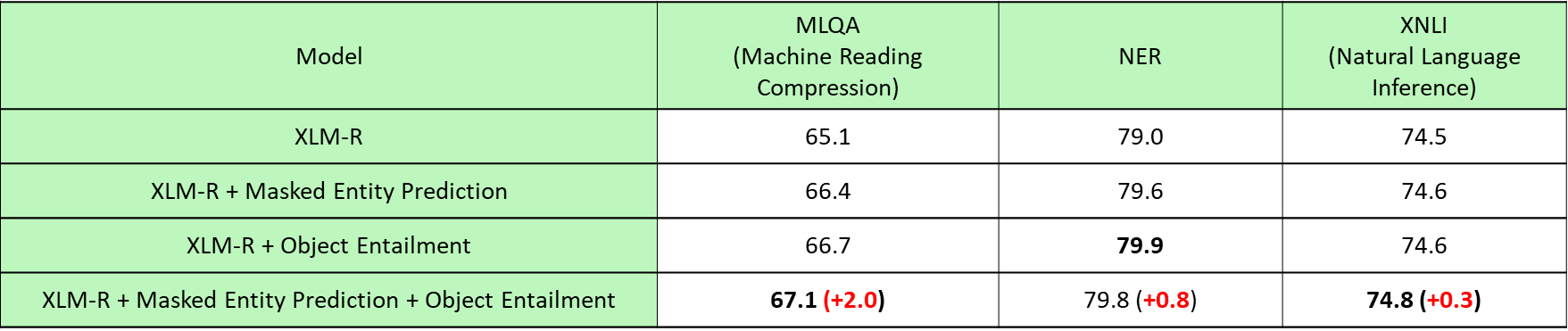

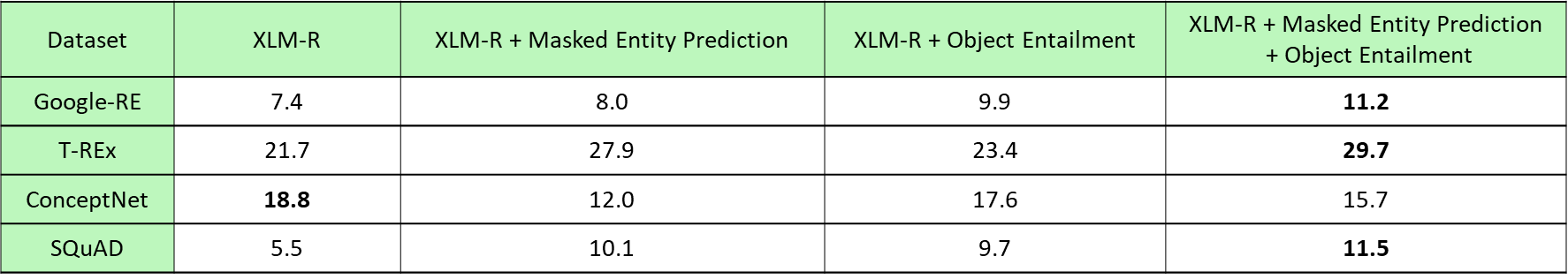

在具体任务上的测试表明了 XLM-K 模型可以显著提高知识相关的任务的性能。可以看到,该模型在阅读理解和命名体识别上有较大的提升,在普通文本任务上效果持平。

表6:跨语言下游任务评测结果

最后,研究员们用知识探针任务来测试 XLM-K 模型对知识的记忆程度。知识探针任务把知识库中的知识转化成带有掩码的句子,例如“爱因斯坦出生在____”。模型需要直接预测”德国“。由结果可见,XLM-K 模型取得了更好的记忆效果。这也表明了研究员们的模型更好地融入了知识库。

表7:知识探针评测结果

用于文本摘要任务的序列级对比学习模型

论文链接:https://arxiv.org/abs/2109.03481

文本摘要(Text Summarization)的主要目标就是提炼一篇长文章的主要内容,将其改写成一篇概括性的摘要。按照改写的方式,通常将摘要分为抽取式摘要和生成式摘要两种。抽取式摘要是指从原文中抽取几个句子作为摘要,而生成式摘要则需要模型对整个长文章有一个整体的理解,然后生成一段简洁、连贯的摘要。

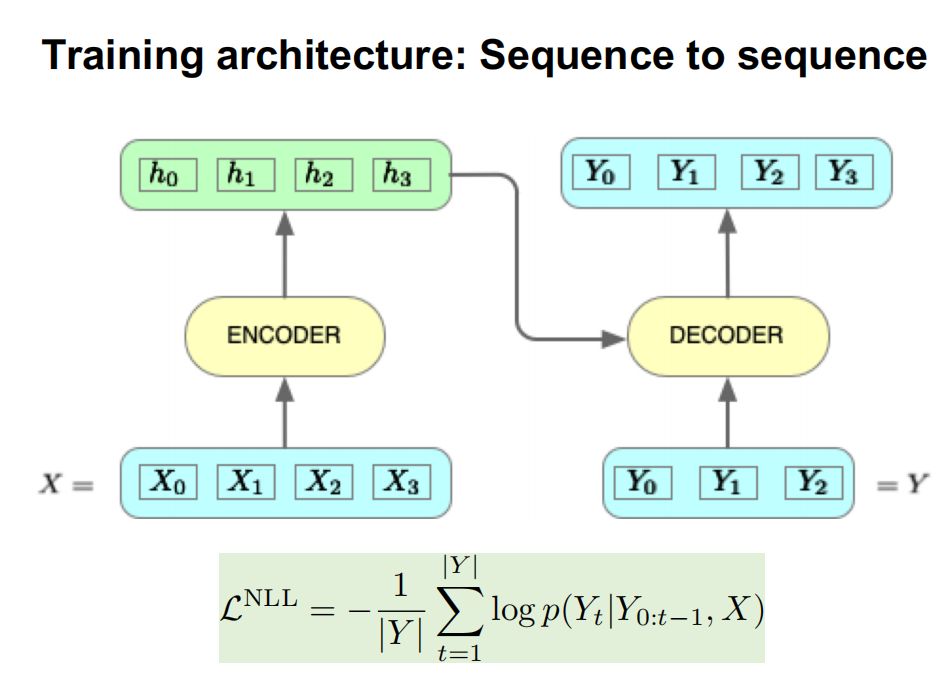

目前来说生成式摘要主要是在 sequence-to-sequence 框架下完成的(如图13所示)。通过一个编码器(Encoder)对长的文章进行编码,再用一个解码器(Decoder)对编码后的信息进行解码并生成想要的摘要。在训练过程中,通常使用的是NLL(Negative Log Likelihood)作为损失函数。

图13:Sequence-to-Sequence 训练中使用的 NLL 损失函数

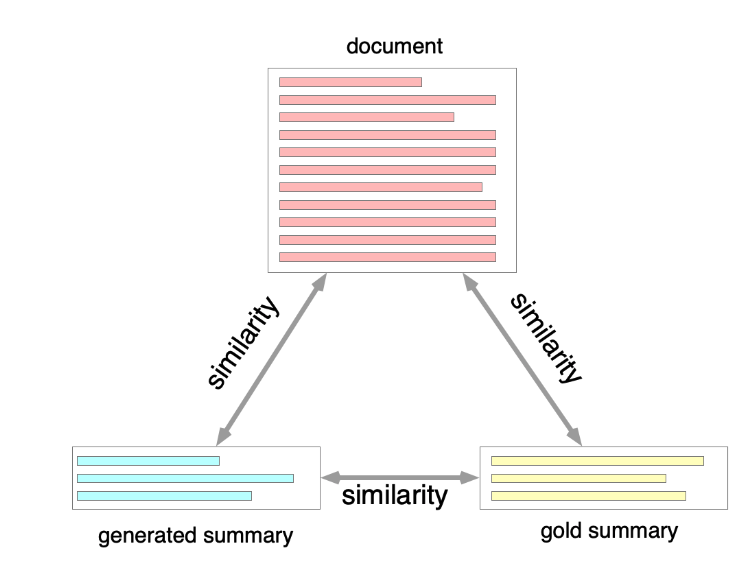

但是微软亚洲研究院的研究员们意识到 NLL 并没有很好地建模文本摘要任务一个重要的特点:文章和摘要虽然长度的差别很大,但是所描述的主要内容应该是一致的。为了更好地在训练过程中强调这一点,研究员们引入了序列间对比学习模型 SeqCo(Sequence-level Contrastive Learning),将文章和摘要映射到成同一个向量空间的两个序列,并且在该向量空间内拉近文章序列和摘要序列的相似度。

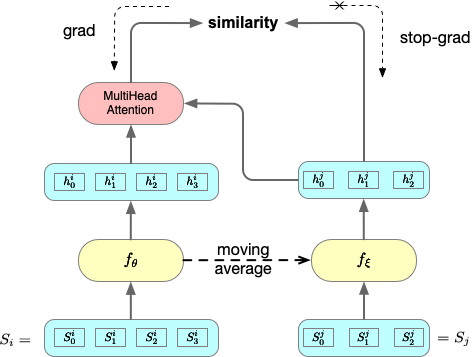

除此之外,为了增加训练样本的多样性,研究员们还将模型生成的摘要也加入到训练样本中。整个训练过程在优化 NLL 的同时,也在拉近原文章、目标摘要和模型生成的摘要三者的相似度(如图15所示)。在训练过程中,跟 BYOL 类似,研究员们采用了双塔型的结构(见图14)。为提高训练的稳定性,对比学习目标端的参数为其对比端的移动平均值(moving average)并停止梯度回传。

图14:训练过程的对比学习损失函数

图15:拉近原文章、目标摘要和模型生成的摘要三者的相似度

实验结果表明,和仅仅使用了 NLL 作为损失函数的模型相比,在训练中引入对比学习使得模型的效果在 CNNDM、XSum 和 NYT 摘要数据集上都得到了显著的提升(表8为在 CNNDM 上的结果,在其他数据集上的结果具有相同趋势)。

表8:CNN/DM数据集上不同方法的性能比较

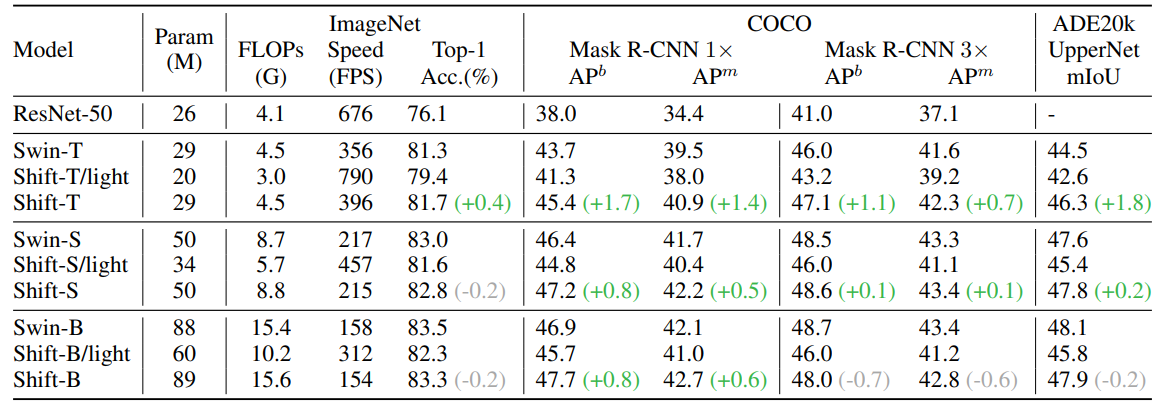

针对图片识别的稀疏MLP:自注意力机制真的是必要的吗?

论文链接:https://arxiv.org/pdf/2109.05422.pdf

代码链接:https://github.com/microsoft/SPACH

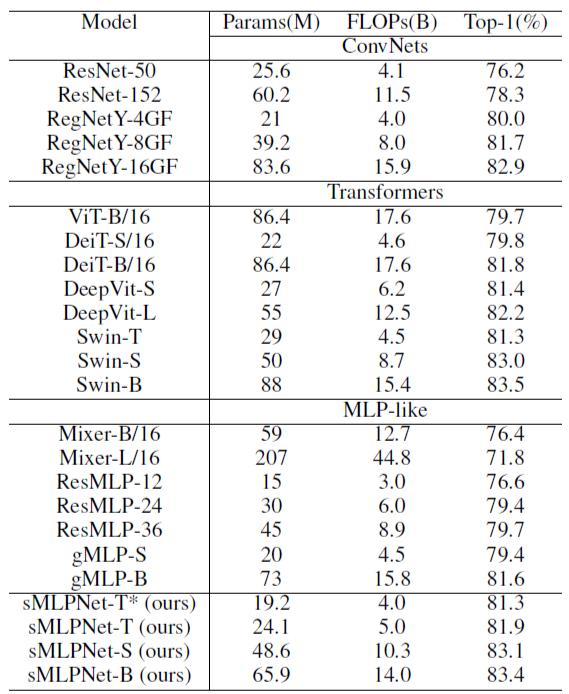

最近,Transformer 在计算机视觉领域取得了领先性能并得到了学者的广泛关注。其中,自注意力机制(Self-Attention)是 Transformer 取得成功的核心模块。它以一种动态的方式捕获图片的全局感受野。然而,由于需要计算每两个 token 之间的关系,它的时间复杂度是平方量级的,因此,难以处理高分辨率图片,并且对金字塔结构(pyramid structure)很不友好。而高分辨率输入和金字塔结构是提高图片识别性能的关键要素。此外,Transformer 完全摒弃了局部偏置(locality bias)。这种局部偏置也是卷积神经网络在计算机视觉取得成功的重要因素。

另一方面,也有学者对自注意力机制的必要性提出了质疑。MLP-Mixer设计了一种单纯使用多层感知机(MLP)的网络架构。它与基于 Transformer 的网络架构 ViT 的主要区别是在空域上进行 token 之间的交互时仅使用了 MLP 来替代自注意力机制。MLP 由于参数量大容易过拟合,因此效果与基于 Transformer 的方法比还有差距。然而,这并不能证明自注意力机制一定是必要的。

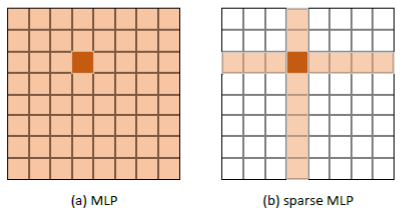

在进行全局建模时,本文设计了一种不基于自注意力机制的方法——稀疏的多层感知机(sparse MLP)模块。每个 token 只与其所在行和所在列的 token 进行直接交互。这种方法参数量低,缓解了 MLP 容易过拟合的问题,同时又可以快速地捕获全局感受野。

图16:传统 MLP 与本文提出的稀疏 MLP 对比示意图

基于 sparse MLP,配合局部偏置和金字塔结构这种对于图片识别很重要的设计理念,该方法达到了和基于自注意力机制的方法一样的性能。这说明自注意力机制并不是必须的,也希望本文可以启发更多研究人员关注不基于自注意力机制的方法。

表9:在 ImageNet-1k 上与主流方法的性能比较

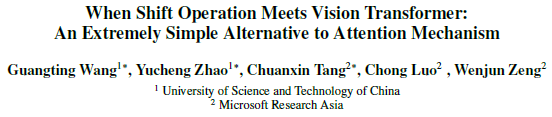

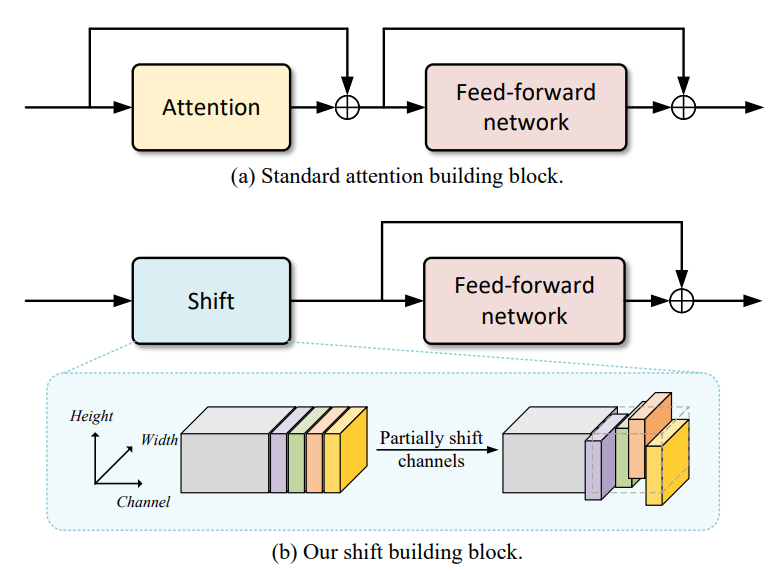

Shift 操作与 Transformer 的结合:一种高效的 Attention 替代方案

代码链接:https://github.com/microsoft/SPACH

最近, Vision Transformer 的结构引起了研究者们的广泛关注。在许多计算机视觉的任务中,Vision Transformer 都取得了领先的性能。那么,由此引发的一个问题就是:Vision Transformer 性能优异的原因究竟是什么?

此前,许多研究者相信,自注意力机制(Self-Attention)是让Vision Transformer 成功的主要原因。相比与常见的卷积操作,自注意机制提供了一种全局的(global)、动态的(dynamic)方式去建模图像中的空间关系。但是,最近的一些研究表明,全局性和动态性可能都不是必须的,例如 Swin Transformer 将全局的 Attention 转换为局部的 Attention;MLP-Mixer 将动态的聚合权重变成了固定的全连接层。实验证明,这些简化都没有损害自注意力机制的性能。为了进一步探索是什么让 Transformer 成功,微软亚洲研究院的研究员们希望进一步去简化 Attention 的模块。具体来说,研究员们将简化推向一种极端情况:没有全局性、没有动态性、甚至没有参数、没有算术运算。这个操作就是邻域的移位操作(Shift)。

移位操作在计算机视觉已经有了很成功的应用。所以研究员们借鉴了部分移位的设计,其结构如图17所示。对于输入的特征,研究员们将一部分的通道向上、下、左、右四个方向分别移位一个像素。通过这种方式,使得模型能够获取邻域位置的信息。

图17:Shift 模块与标准注意力模块对比示意图

研究员们采用这个简单的操作去替代 Swin Transformer 中的 Attention。令人惊讶的是,在许多视觉任务上,它的效果并不亚于 Swin Transformer。这说明 Transformer 成功的因素可能并不完全是由于 Attention :哪怕是这么一个0参数量、0计算量的简单操作都能够取得相近的性能。因此,在今后的研究中,Transformer 的一些设计细节或许也应该受到大家的重视,例如训练细节、归一化的方式等等。在文章中,微软亚洲研究院的研究员们也进行了一些初步的探讨,希望能够启发大家的思考。

表10:与基准模型在各视觉任务中的性能对比

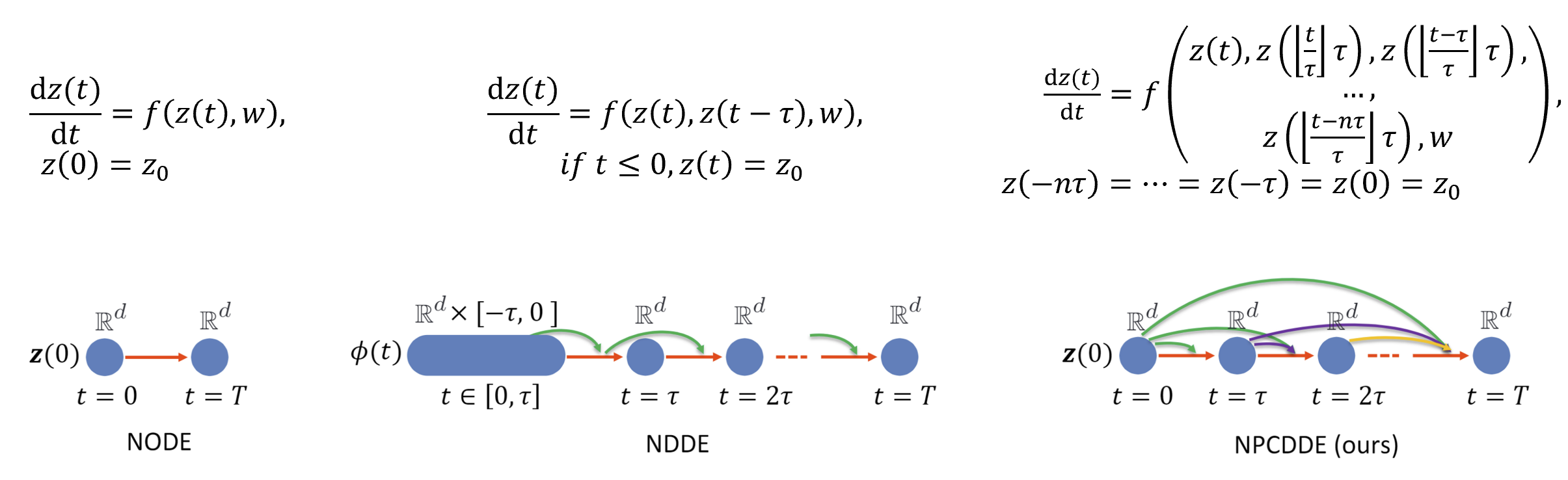

神经分段常时滞微分方程

论文链接:https://arxiv.org/abs/2201.00960

连续深度神经网络框架(如神经常微分方程),在时间序列分析、生成模型构建、物理系统建模等领域取得了广泛的应用。但神经微分方程的微分同胚性质导致其不具备万有逼近能力,无法表示一些简单的函数,比如,反射函数f(x)=-x.。为了克服该问题,不少学者提出了相应的连续深度神经网络框架,例如增维神经常微分方程、神经时滞微分方程(neural delay differential equation, NDDEs)等。

本文提出了一类新的具有时滞的连续深度神经网络,称为神经分段常时滞微分方程(neural piecewise-constant delay differential equations, NPCDDEs)。与之前提出的 NDDEs 框架不同, 研究员们将单个时滞转换为分段常时滞(piecewise-constant delay)。

图18:模型框架示意图

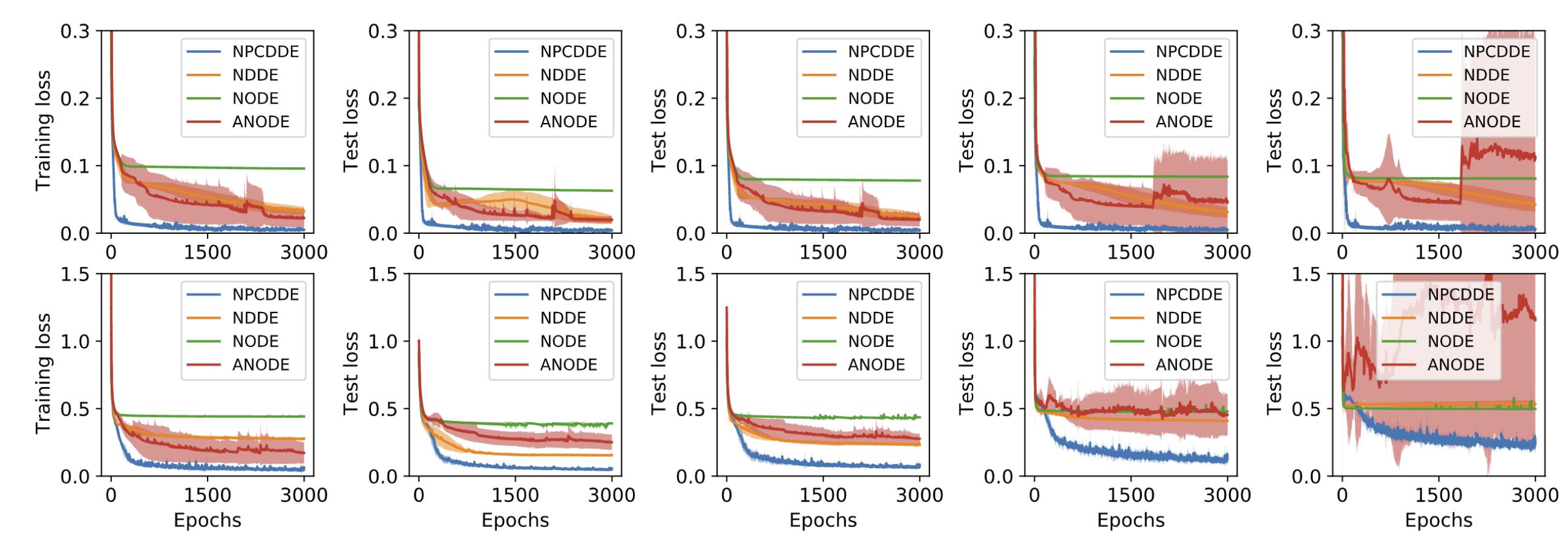

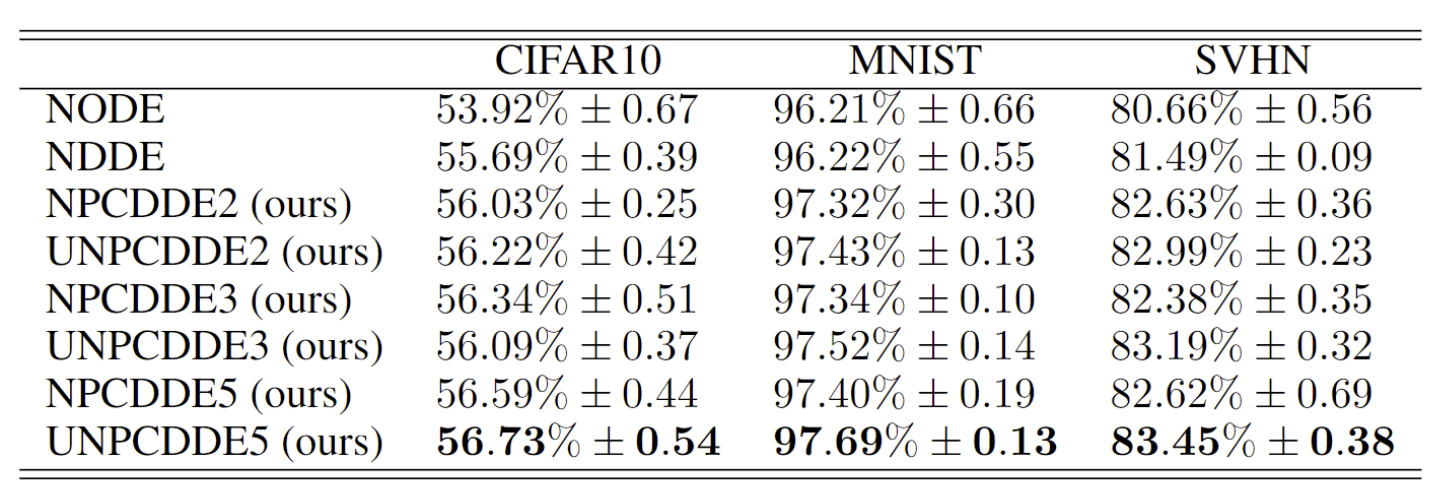

经过这样转换后的 NPCDDEs 一方面继承了 NDDEs 中的万有逼近能力的优势,另一方面,NPCDDEs 考虑了多个过去时刻的信息,进一步提高了模型能力。此外,研究员们还考虑了不同时段采用不同参数的 NPCDDE,称之为 unshared NPCDDEs (UNPCDDEs),正如一般的前馈神经网络(如ResNets层与层之间的参数是不共享的)。并且研究员们还指出 ResNets 和 NODEs 都是 UNPCDDEs 的特殊形式。研究员们在不同数据集,包括1维分段常时滞种群动力学实例和图像数据集(MNIST, CIFAR10和SVHN)上,证明了 NPCDDEs/UNPCDDEs 的性能优于目前具有代表性的连续深度神经网络模型。

图19:不同神经微分方程在1维分段常时滞种群动力学上的性能比较

表11:不同神经微分方程在 CIFAR10, MNIST, SVHN 图像数据集上的性能比较.

所有这些结果表明将动力系统的要素融入到现有的神经网络框架中,有利于连续深度神经网络的发展。

一致性信息瓶颈在域泛化中的应用

论文链接:https://arxiv.org/abs/2106.06333

领域泛化(Domain Generalization)旨在从不同的分布中学习到一个泛化能力更好的模型。一致性风险最小化(IRM)(Arjovsky 2019)是领域泛化方向里比较重要的算法之一,其致力于寻求条件独立于标签的特征分布一致性(invariance of feature-conditioned label distribution)。但是 IRM 也存在着对于伪一致性特征(pseudo-invariant features)的依赖,以及在数据分布存在 geometric-skews 的时候,即数据都存在一部分伪特征可以用于分类且数据量较大时(即P(z_sp * y) > 0.5),模型会偏向建立一个 short-cut classifier 用于分类,而非考虑数据中更广为存在且一致性更强的特征。

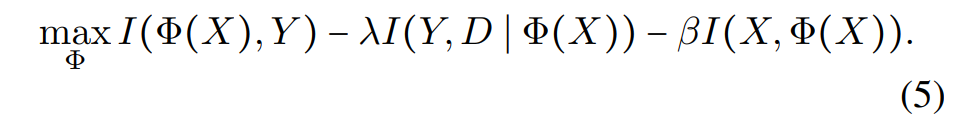

微软亚洲研究院的研究员们认为这种问题源自于对特征的过度依赖,从而导致了 pseudo-invariance 和 geometric-skews 的存在。因此,研究员们在本文中提出使用信息瓶颈的方法对特征的维度进行正则化约束,进而提出了一致性信息瓶颈(Invariant Information Bottleneck,IIB),IIB旨在使用含有输入数据信息尽量少,且尽量在不同分布间具有条件一致性的特征用于建立分类模型。研究员们将 IRM 的优化目标写成互信息的形式,结合信息瓶颈的互信息优化目标,从而可以导出 IIB 的互信息优化目标,视作如下:

进一步,研究员们在神经网络框架下,采取变分推断的方式逼近以上的互信息目标。IIB 整体的结构如下:

图20:IIB 整体结构

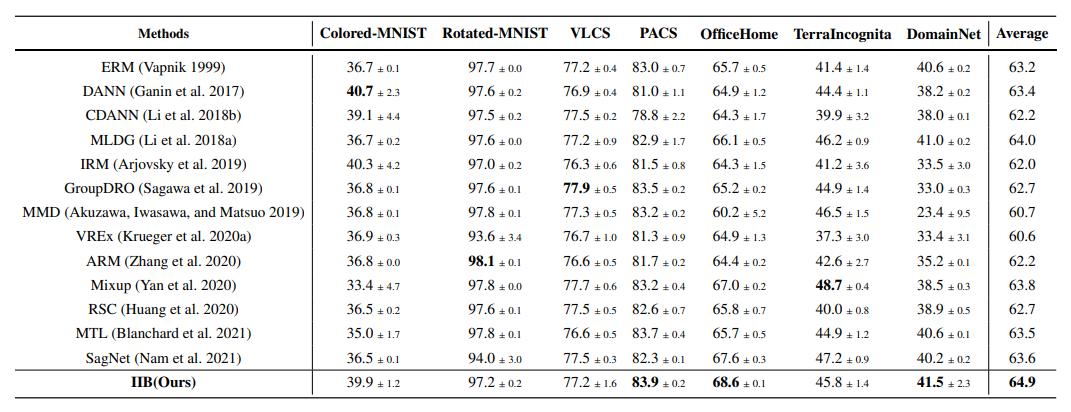

IIB 在公有的 DomainBed 数据集中表现良好,超越已有基线方法0.9%。

表12:IIB 在 DomainBed 数据集的表现

概括地讲,IIB 在 IRM 的基础上加入对特征的信息瓶颈(IB)约束,并且将 IRM 和 IB 的优化目标统一为互信息形式加以变分推断,进行优化。这种较新的优化方式能够在用于检验 pseudo-invariance 和 geometric-skews 的合成数据集中相比于 IRM 有明显的提升,同时也能在 DomainBed 这种大型的真实数据集中取得较好的效果。

使用点反馈与标准离线黑箱算法的在线影响力最大化问题

论文链接:https://arxiv.org/abs/2109.06077

本文研究了在线影响力最大化问题:玩家与未知社交网络进行多轮交互,每轮需要选取种子集合投放信息,然后观察社交网络上信息传播过程的反馈数据,据此学习网络参数并更新选取策略,最终最小化多轮交互的累积悔值,即每轮选取的集合与使得影响力最大化的最优集合的差距之和。

文献中通常研究两种反馈数据类型:点反馈和边反馈。点反馈揭示哪些节点何时被激活,边反馈则额外揭示信息经由哪些边传播。算法设计中通常需要调用离线影响力最大化算法帮助选择每轮的种子集合。标准离线黑箱算法只需优化种子集合本身,文献中存在大量可高效实现的这类算法;而非标准离线黑箱算法需要同时优化种子集合和网络参数,这是难以实现的。

本文针对独立级联(IC)和线性阈值(LT)传播模型,各自设计了一个基于点反馈数据并且使用标准离线黑箱算法的最优悔值在线算法,改进了之前 IC 模型下基于边反馈的算法和LT模型下使用非标准黑箱的算法。本文提出变种极大似然估计方法来处理点反馈数据,通过定义并优化伪似然函数来学习网络参数。本文的分析能够针对每个参数得到一个置信区间,从而使得调用标准离线黑箱算法成为可能。而前人工作在使用点反馈数据时,只能针对参数向量得到一个高维置信域,从而必须调用非标准离线黑箱算法。

看完今天的论文分享是不是还意犹未尽?想了解更多人工智能领域学术界和产业界的前沿研究吗?扫描下方二维码,来 B 站观看 AAAI 2022 论文分享会完整视频回放!更多论文分享,也请关注 B 站“微软中国视频中心”账号。